在人工智能和机器学习领域,nvidia gh200 grace hopper superchip首次亮相。超级芯片在mlperf行业基准测试中表现出卓越的性能,沉着地运行所有数据中心推理测试。这一成就证明了 nvidia 自 2018 年 mlperf 基准测试启动以来致力于突破人工智能技术的界限及其始终如一的性能领先地位。

gh200 superchip是hopper gpu和grace cpu的独特组合。这种合并提供了更多的内存、带宽以及在 cpu 和 gpu 之间转移功率以优化性能的能力。这种创新设计使 nvidia 的 h100 gpu 和 grace hopper superchips 能够在 mlperf 的所有数据中心测试中处于领先地位,包括计算机视觉、语音识别和医学成像的推理。

英伟达gh200格雷斯漏斗超级芯片

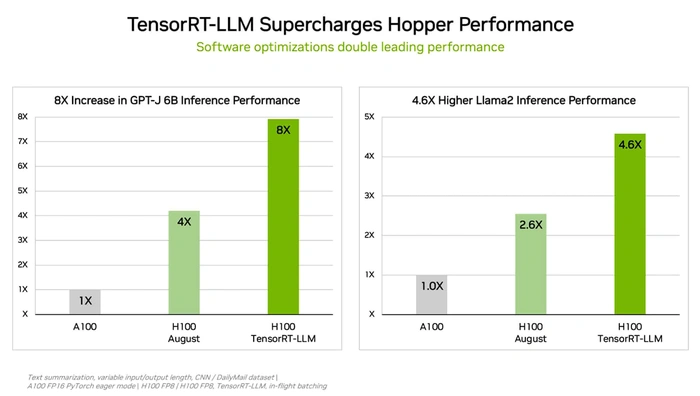

为了进一步优化推理,nvidia 开发了 tensorrt-llm,这是一款开源生成 ai 软件。该软件使客户能够在不增加成本的情况下将其 h100 gpu 的推理性能提高一倍。在h100 gpu上使用时,与在没有软件的情况下运行gpt-j 8b的上一代gpu相比,tensorrt-llm提供了高达6倍的性能提升。这是性能的重大飞跃,表明了 nvidia 致力于为客户提供价值的承诺。

nvidia 的 l4 gpu 在最新的 mlperf 也提供了令人印象深刻的性能。它们提供的性能比额定功耗高出近 6 倍的 cpu。这些gpu可从google cloud和许多系统制造商处获得,为从消费者互联网服务到药物发现等行业的客户提供服务。

为了进一步展示其创新方法,nvidia 应用了一种新的模型压缩技术,在 l4 gpu 上运行 bert llm 实现了高达 7.4 倍的性能提升。这项技术展示了 nvidia 致力于不断提高其产品性能的承诺。

与上一轮相比,nvidia jetson orin 系统模块在对象检测方面也显示出高达 84% 的显着性能提升。这是 edge ai 和机器人场景中的常见用例,进一步证明了 nvidia 技术的多功能性和适用性。

mlperf 基准测试得到了 70 多家组织的支持,包括阿里巴巴、arm、思科、谷歌、哈佛大学、英特尔、meta、microsoft 和多伦多大学,是衡量人工智能行业绩效的可靠指标。nvidia 在这些的卓越表现证明了其技术实力和对创新的承诺。

为了促进透明度和协作,nvidia 基准测试中使用的所有软件都可以从 mlperf 存储库获得。这让每个人都能取得同样的世界级成果,培养人工智能行业共享学习和进步的精神。

nvidia gh200 grace hopper superchip在mlperf基准测试中的卓越性能证明了nvidia致力于突破ai技术界限的承诺。凭借 hopper gpu 和 grace cpu 的创新组合、开源软件和新模型压缩技术,nvidia 继续在 ai 训练和推理方面处于领先地位。

未经允许不得转载:凯发k8ag旗舰厅 » nvidia gh200 superchip基准测试hopper gpu和grace cpu组合